Generativní AI (GenAI) se za poslední rok stala jedním z nejžhavějších technologických trendů, které si získaly velkou pozornost. Rychlý vývoj velkých jazykových modelů (LLM) a nástrojů, jako je ChatGPT, přiměl organizace prozkoumat potenciální výhody GenAI. I když možná dosahujeme vrcholu poněkud nafouknutých očekávání ohledně této technologie, je zásadní, aby bezpečnostní manažeři věděli, jak vidět její širší rozsah aplikací.

Mnoho dodavatelů zabezpečení začleňuje umělou inteligenci (AI) – zejména strojové učení (ML) – již roky, aby zlepšili efektivitu řešení a zlepšili jejich schopnosti. Umělá inteligence má obrovský potenciál k posílení bezpečnosti organizací a umožňuje obráncům zůstat před hrozbami. Je však nutné si uvědomit, že AI má různé případy použití. Například funkce založené na AI/ML jsou jen tak dobré, jako jsou data a procesy používané k trénování modelů, včetně velikosti a kvality datových sad, sledování změn v distribuci dat atd. . Složitost technologie vytváří další překážky a omezení; A přestože umělá inteligence dokáže v některých složitých úkolech překonat lidi, není to vždy ten nejefektivnější přístup.

Umělá inteligence ve svém jádru není univerzálním řešením bezpečnostních problémů. Při postupu vpřed v obraně zvažte rozsah případů použití AI a pokládejte podrobné otázky dodavatelům zabezpečení, abyste pochopili, která řešení jsou pro organizaci nejvhodnější.

Sliby a možnosti obrany založené na umělé inteligenci

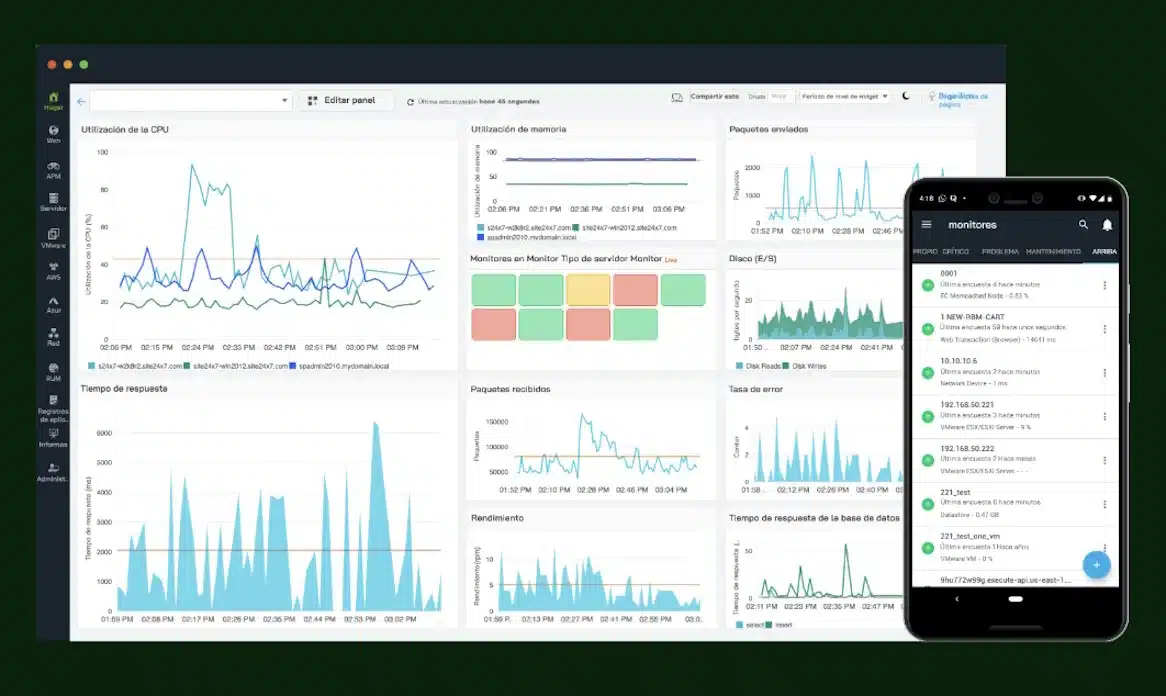

Systémy umělé inteligence jsou obzvláště zběhlé v identifikaci vzorů v obrovském množství dat a na jejich základě předpovědi. Podívejte se na podvody s přesměrováním mezd a přesvědčte se o výhodách umělé inteligence: Tyto stále častější obchodní e-mailové útoky (BEC) se systematicky vyhýbají odhalení. Podle hodnocení společnosti Proofpoint bylo pouze za jeden měsíc zjištěno, že více než 400 hrozeb zneužívání mezd obešlo 12 nástrojů pro zabezpečení e-mailu.

Tyto útoky se obtížně odhalují, protože obvykle neobsahují užitečné zatížení, jako jsou odkazy nebo přílohy. Tradiční řešení zabezpečení e-mailů založená na rozhraní API navíc analyzují hrozby po doručení, což vyžaduje mnoho času na straně IT nebo bezpečnostních týmů, aby nástroj dodaly datům. Protože tento přístup není škálovatelný, mnoho týmů se rozhodne implementovat tyto ovládací prvky pouze pro vybranou skupinu, jako jsou například vedoucí pracovníci. Kyberzločinci se však při provádění útoků na sifonování mezd zaměřují na mnohem širší kategorii lidí v rámci organizace.

Právě tam nabízejí nástroje založené na AI/ML, včetně Generative AI (GenAI), obrovskou výhodu. Detekce hrozeb založená na AI/ML spolu s detekcí před doručením založená na LLM lze použít k interpretaci kontextuálního tónu a záměru e-mailu. Tento přístup před doručením chrání organizaci blokováním podvodných a škodlivých e-mailů dříve, než se dostanou k zaměstnancům, čímž se výrazně minimalizuje vystavení hrozbám, jako je BEC.

Ne všechny nástroje AI jsou stejné

Ke správnému fungování potřebují řešení AI a ML velké množství vysoce kvalitních dat, protože modely se učí spíše ze vzorů a příkladů než z pravidel. Školení těchto modelů s miliony denních e-mailů z globálního ekosystému zpravodajství o hrozbách, jako je Proofpoint, zajišťuje vyšší věrnost detekce a poskytuje bezpečnostním týmům větší důvěru v efektivitu jejich zabezpečení.

Dvousečný kybernetický meč: jak využít AI v obraně, abyste se dostali před útočníky

Před přijetím nových řešení, která jsou založena na AI a ML, by se proto poskytovatelům měly položit otázky jako:

- Kde získáváte data pro trénování algoritmů? Získávání dat pro všeobecné aplikace umělé inteligence je snadné, ale údaje o hrozbách nejsou tak hojné. Školicí data používaná dodavatelem by měla odrážet nejen reálné scénáře, ale také konkrétní hrozby, kterým organizace a její zaměstnanci čelí.

- Co používáte při detekci pro doplnění AI/ML? Chytrá technologie není pro některé typy hrozeb tak účinná, efektivní nebo spolehlivá. Je zásadní, aby bezpečnostní řešení integrovalo další techniky, jako jsou pravidla, podpisy nebo procesy „human-in-the-loop“, do kterých jsou zapojeni lidé.

Ještě předtím, než se pustíte do těchto podrobností, musíte vyhodnotit, zda je AI optimální pro konkrétní výzvy organizace a lidí v ní. Modely AI jsou složité a výpočetně náročné a jejich spuštění může trvat déle než méně komplikované funkce. Někdy jsou techniky založené na pravidlech účinnější, zvláště když je nutná rychlá reakce. Musíte vidět, jakého bezpečnostního cíle se snažíte dosáhnout a jaká cesta je nejlepší k jeho dosažení.

Stále žádné prohlášení o GenAI

Mnoho dodavatelů zabezpečení již roky v tichosti integruje AI, ale úsilí GenAI musí být mnohem viditelnější.

Na jedné straně se GenAI posouvá mnohem dále do cyklu hype než jakákoli jiná technologie před ním. Dokonce i vlády, které obvykle reagují pomalu, už bily na poplach, jak ukázal výkonný příkaz amerického prezidenta k řešení rizik této rychle rostoucí technologie.

Protože se bezpečnostní komunita snaží porozumět důsledkům umělé inteligence, nemůžeme ignorovat skutečnost, že ji mohou využít i kyberzločinci ve svůj prospěch, a proto se jedná o dvousečný meč.

Zejména GenAI se stala nejrychleji rostoucí oblastí zájmu organizací. IT a bezpečnostní týmy berou tuto hrozbu vážně, s vedoucími představiteli firmy. V celosvětovém průzkumu provedeném společností Proofpoint v loňském roce mezi více než 600 členy představenstva se 59 % domnívá, že vznikající technologie jako GenAI představují pro jejich organizaci bezpečnostní riziko.

Útočníci již tuto technologii využívají a využívají open source LLM k vývoji škodlivých nástrojů, jako jsou WormGPT, FraudGPT a DarkBERT. Ty umožňují útočníkům vytvářet lepší phishingové e-maily a překládat je do více jazyků.

Není pochyb o tom, že generativní umělá inteligence otevírá nové možnosti pro naše protivníky, ale přinejmenším prozatím může být mnoho obav, které s ní souvisí, poněkud přehnané. Útočníci se nehodlají vzdát ani znovu vynalézt svou taktiku, dokud zůstanou lukrativní, takže se obránci musí zaměřit na nejbezprostřednější hrozby a zajistit, aby měli na místě základní ochranu.

Autor: Daniel Rapp, viceprezident pro AI/ML ve společnosti Proofpoint

Čerpáme z těchto zdrojů: google.com, science.org, newatlas.com, wired.com, pixabay.com