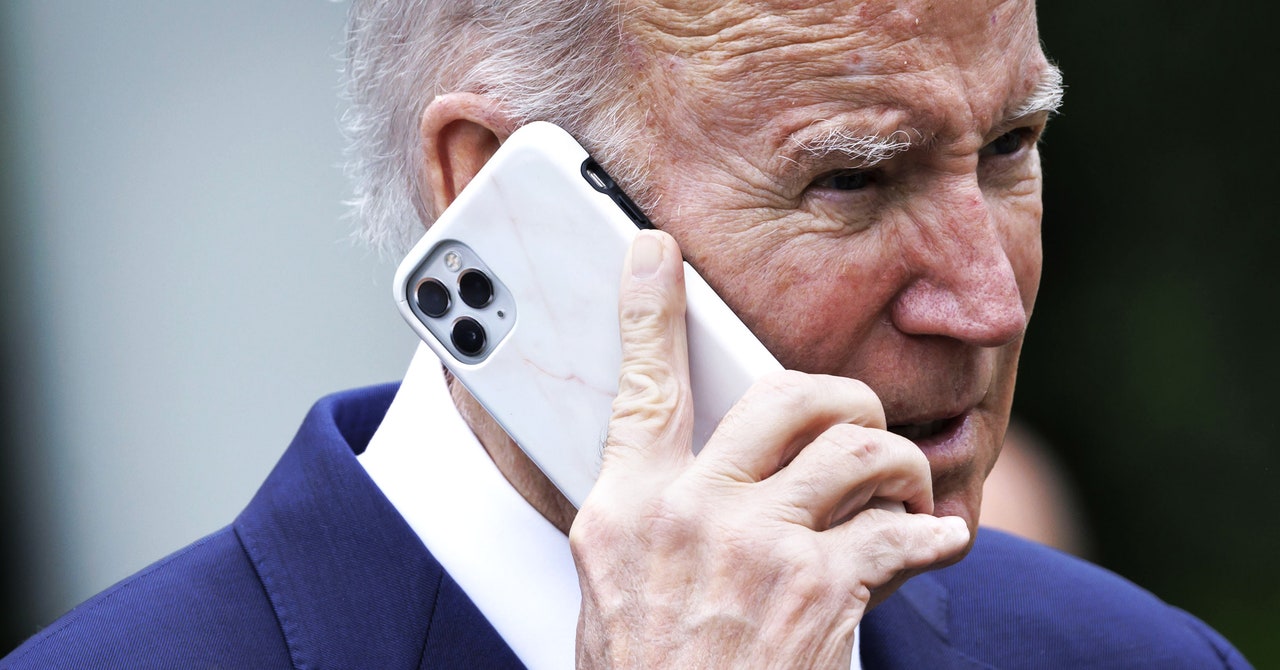

Minulý týden někteří voliči v New Hampshire obdrželi robotický hovor vygenerovaný umělou inteligencí, který se vydával za prezidenta Bidena a který jim řekl, aby nevolili v primárních volbách ve státě. Není jasné, kdo byl za hovor zodpovědný, ale dva samostatné týmy zvukových expertů říkají WIRED, že byl pravděpodobně vytvořen pomocí technologie od startupu ElevenLabs pro klonování hlasu.

ElevenLabs prodává své nástroje AI pro použití jako audioknihy a videohry; nedávno dosáhla statusu „jednorožce“ tím, že získala 80 milionů dolarů při ocenění 1,1 miliardy dolarů v novém kole financování společně vedeném rizikovou společností Andreessen Horowitz. Kdokoli se může přihlásit k placené službě společnosti a naklonovat hlas ze zvukové ukázky. Bezpečnostní politika společnosti říká, že je nejlepší získat něčí povolení před klonováním jeho hlasu, ale že klonování bez povolení může být v pořádku pro různé nekomerční účely, včetně „politických projevů přispívajících k veřejným debatám“. ElevenLabs nereagovala na více žádostí o komentář.

Pindrop, bezpečnostní společnost, která vyvíjí nástroje k identifikaci syntetického zvuku, ve čtvrtek na blogu tvrdila, že její analýza zvuku z hovoru poukázala na technologii ElevenLabs nebo „systém využívající podobné komponenty“. Výzkumný tým Pindrop zkontroloval vzory ve zvukovém klipu proti více než 120 různým motorům hlasové syntézy a hledal shodu, ale neočekával, že nějakou najde, protože identifikace původu zvuku generovaného umělou inteligencí může být obtížné. Výsledky byly překvapivě jasné, říká generální ředitel Pindrop Vijay Balasubramaniyan. „Z 99 procent se vrátilo, že to byly ElevenLabs,“ říká.

Tým Pindrop pracoval na 39sekundovém klipu, který společnost získala z jednoho z robotických hovorů generovaných umělou inteligencí. Snažila se ověřit své výsledky také analýzou zvukových vzorků, o nichž je známo, že byly vytvořeny pomocí technologie ElevenLabs, a také pomocí jiného nástroje pro syntézu hlasu, aby zkontrolovala metodiku.

ElevenLabs nabízí na svých webových stránkách svůj vlastní AI detektor řeči, o kterém říká, že dokáže zjistit, zda byl zvukový klip vytvořen pomocí technologie společnosti. Když Pindrop provedl svůj vzorek podezřelého robotického volání tímto systémem, vrátil se s 84procentní pravděpodobností, že bude vygenerován pomocí nástrojů ElevenLabs. WIRED nezávisle získal stejný výsledek při kontrole zvukového vzorku Pindrop pomocí detektoru ElevenLabs.

Hany Farid, specialista na digitální forenzní vědu z UC Berkeley School of Information, byl zpočátku skeptický k tvrzení, že Bidenův robocall pochází z ElevenLabs. „Když slyšíte zvuk z klonovaného hlasu z ElevenLabs, je to opravdu dobré,“ říká. „Verze Bidenova volání, kterou jsem slyšel, nebyla nijak zvlášť dobrá, ale ta kadence byla opravdu zábavná.“ Prostě to neznělo v kvalitě, kterou bych od ElevenLabs očekával.“

Ale když Farid nechal svůj tým v Berkeley provést vlastní nezávislou analýzu zvukového vzorku získaného Pindropem, dospěl také ke stejnému závěru. „Náš model s velkou jistotou říká, že je generován AI a pravděpodobně to bude ElevenLabs,“ tvrdí.

Není to poprvé, co vědci podezřívali nástroje ElevenLabs pro politickou propagandu. Loni v září společnost NewsGuard, která sleduje online dezinformace, tvrdila, že účty TikTok sdílející konspirační teorie pomocí hlasů generovaných umělou inteligencí, včetně klonu hlasu Baracka Obamy, používají technologii ElevenLabs. „Více než 99 procent uživatelů naší platformy vytváří zajímavý, inovativní a užitečný obsah,“ uvedl ElevenLabs v e-mailovém prohlášení pro The New York Times v té době „ale uznáváme, že existují případy zneužití, a neustále jsme vyvíjeli a uvolňovali ochranná opatření, abychom je omezili.“

Čerpáme z těchto zdrojů: google.com, science.org, newatlas.com, wired.com, pixabay.com